2018-04-12[n年前へ]

■チェンマイのタイ旧正月のソンクラーン(水掛け祭り)

チェンマイでタイ旧正月ソンクラーン(水掛け祭り)を、地上数メートルの上空から撮ってみました。氏改善方向を撮影することができるRicohのデジカメ Theta Sが出たときは「レンズを向けなかった方向すべてを撮影できて面白い」と思ったけれど、ドローン映像のような「カメラを置きたいと思った場所に、カメラを置けること」はそれを遙かに超える感動があった。来年今頃のカメラは、みんなそうなっているのかもしれない。

ずっと昔、京都の写真スタジオでバイトをしに行っていた時、「カメラマンは良い風景を予測して、その場所にいるようにすること、そんな場が生まれるように動くこと」と習った。もしかしたら、これからのカメラはデバイスを進化させる今のSONYみたいな方向と、カメラマンの可能性を高める視点自由度や何かしらの可能性を高めるまた別の方向が必要とされているのかもしれない。

2018-04-22[n年前へ]

■Python(Pythonista)でiOSカメラを自由自在に使ってみる

iPhone/iPadなどの機器のカメラは、焦点位置や露光時間や感度など、わりと細かく制御することができます。そうした撮影処理を使って、露光時間を変えた撮影を何枚もして画像(ハイダイナミックレンジ:HDR)合成をしたり、焦点位置を変えた撮影から焦点合成(フォーカススタッキング)を行ったりすると、意外に楽しいものです。とはいえ、そんなコード遊びをするのに、毎回Objective-C(やC++)でコーディングするのは少し面倒です。

iPhone/iPadなどの機器のカメラは、焦点位置や露光時間や感度など、わりと細かく制御することができます。そうした撮影処理を使って、露光時間を変えた撮影を何枚もして画像(ハイダイナミックレンジ:HDR)合成をしたり、焦点位置を変えた撮影から焦点合成(フォーカススタッキング)を行ったりすると、意外に楽しいものです。とはいえ、そんなコード遊びをするのに、毎回Objective-C(やC++)でコーディングするのは少し面倒です。

というわけで、今日はiOSで動くPython ( Pythonista ) で、iOSのカメラをマニュアル撮影的に使うコードを書いてみました。それが下に貼り付けたPythonコード例です。この例では、焦点制御を無効化した上で、最近接位置から無限遠までのレンズ位置を0.0〜1.0の任意位置に制御しつ、撮影を行うことができます。

「開発用マシンでコードを書いてビルドした上で、スマホに転送して動かす」というような手間を掛けずとも、スマホ上で比較的短いコードを書いて、それをスマホ上で瞬時に動かして「自分だけの特殊撮影マシン」を仕立てて遊ぶことができるのは面白いものです。…今回貼り付けた撮影処理部分は全くPythonっぽくないコードですが、ひとたび「ライブラリ化」してしまえば、こんなコードを見る必要もなく、やりたいことだけをPythonから気楽に実行することができるようになります。…となれば、色々遊んでみたくなる人も多いのではないでしょうか。

# coding: utf-8

from objc_util import *

import time

AVCaptureSession = ObjCClass('AVCaptureSession')

AVCaptureDevice = ObjCClass('AVCaptureDevice')

AVCaptureDeviceInput = ObjCClass('AVCaptureDeviceInput')

AVCapturePhotoOutput = ObjCClass('AVCapturePhotoOutput')

def manualCapture(device, output, focusDistance, fileName):

def captureOutput_didFinishProcessingPhotoSampleBuffer_

previewPhotoSampleBuffer_resolvedSettings_bracketSettings_error_(

_self, _cmd, _output, _photoBuffer, _previewBuffer,

_resolveSettings, bracketSettings, _error ):

photoBuffer = ObjCInstance(_photoBuffer)

jpegPhotoData = ObjCClass('AVCapturePhotoOutput'

).JPEGPhotoDataRepresentationForJPEGSampleBuffer_

previewPhotoSampleBuffer_(

photoBuffer, _previewBuffer)

jpegPhotoData.writeToFile_atomically_(fileName, True )

# delegate

CameraManualPhotoCaptureDelegate = create_objc_class(

'CameraManualPhotoCaptureDelegate',

methods=[

captureOutput_didFinishProcessingPhotoSampleBuffer_

previewPhotoSampleBuffer_resolvedSettings_bracketSettings_error_ ],

protocols=[ 'AVCapturePhotoCaptureDelegate' ])

device.lockForConfiguration_(None)

device.setFocusModeLockedWithLensPosition_completionHandler_(

focusDistance, None)

device.unlockForConfiguration()

time.sleep(1)

delegate = CameraManualPhotoCaptureDelegate.new()

settings = ObjCClass('AVCapturePhotoSettings'

).photoSettings()

settings.AVCaptureFocusMode = 0

output.capturePhotoWithSettings_delegate_(

settings, delegate )

time.sleep(1)

delegate.release()

@on_main_thread

def main():

session = AVCaptureSession.alloc().init()

device =

AVCaptureDevice.defaultDeviceWithMediaType_('vide')

_input =

AVCaptureDeviceInput.deviceInputWithDevice_error_(

device, None)

if _input:

session.addInput_(_input)

else:

return

session.startRunning()

output = AVCapturePhotoOutput.alloc().init()

session.addOutput_(output)

time.sleep(1)

manualCapture(device, output, 0.0, 'sample.jpg')

time.sleep(1)

session.stopRunning()

session.release()

output.release()

if __name__ == '__main__':

main()

2018-04-26[n年前へ]

■販促中!論理的にプレゼンする技術<改訂版> 聴き手の記憶に残る話し方の極意

諸事情色々で、「力一杯の販促(宣伝活動)中」です。以前書いた本の改訂版が出ました。

論理的にプレゼンする技術<改訂版> 聴き手の記憶に残る話し方の極意 (サイエンス・アイ新書) です。

諸事情色々で、「力一杯の販促(宣伝活動)中」です。以前書いた本の改訂版が出ました。

論理的にプレゼンする技術<改訂版> 聴き手の記憶に残る話し方の極意 (サイエンス・アイ新書) です。

内容もより良くバージョンアップされていますし、電子書籍が良い方向けのKindle版ももちろんあります。お勧めの一冊?です…というわけで、一冊買って、近くの方に広めて頂ければ幸いです。

2018-04-28[n年前へ]

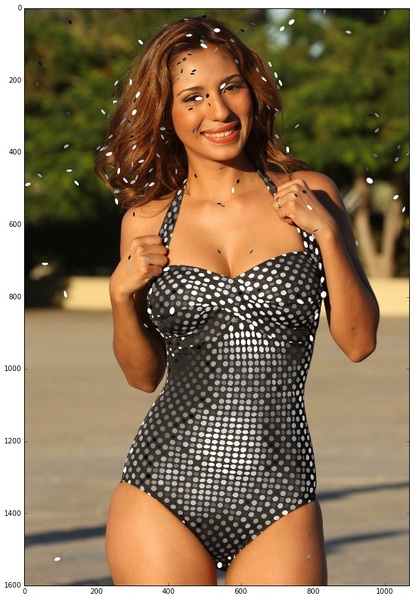

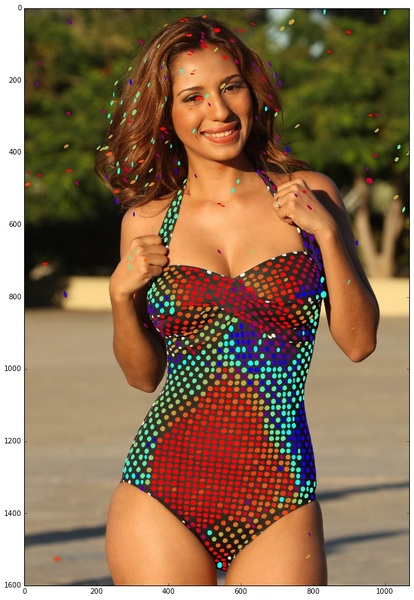

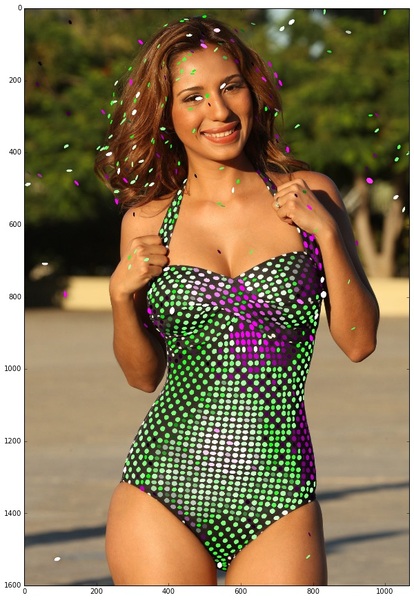

■草間彌生デザインの「水玉模様のモジモジ君ウェア」で人体の表面形状を推定してみよう!

数ヶ月前に買ったつもりのZOZOスーツ、服に取り付けられたセンサ群とスマホの間でさまざまなデータが交換され、自分の体を知ることができるという「面白さ」に惹かれて…はや数ヶ月、「大幅な性能向上」したものが届くという連絡内容を見ると、、そこには「コレジャナイ感が、超大盛りラーメン店のようにテンコ盛りされた、草間彌生デザインの「水玉模様のモジモジ君ウェア」でした。マーカー付けた衣服を使って(スマホによる)画像計測による採寸を行うデザインに変わっていた…というわけです。

数ヶ月前に買ったつもりのZOZOスーツ、服に取り付けられたセンサ群とスマホの間でさまざまなデータが交換され、自分の体を知ることができるという「面白さ」に惹かれて…はや数ヶ月、「大幅な性能向上」したものが届くという連絡内容を見ると、、そこには「コレジャナイ感が、超大盛りラーメン店のようにテンコ盛りされた、草間彌生デザインの「水玉模様のモジモジ君ウェア」でした。マーカー付けた衣服を使って(スマホによる)画像計測による採寸を行うデザインに変わっていた…というわけです。

ネットには、新バージョンのZOZOスーツ試着写真もtwitterにはアップロードされ始めています。そこで、そんなマーカ模様が付けられた服を着用した画像からの人体形状推定をしてみることにしました。「ネットにアップされた画像から」というわけで、多視点撮影からの3次元推定を行うZOZOスーツ正式バージョンとは違い、一枚画像からの体表面形状の推定です。

ネットには、新バージョンのZOZOスーツ試着写真もtwitterにはアップロードされ始めています。そこで、そんなマーカ模様が付けられた服を着用した画像からの人体形状推定をしてみることにしました。「ネットにアップされた画像から」というわけで、多視点撮影からの3次元推定を行うZOZOスーツ正式バージョンとは違い、一枚画像からの体表面形状の推定です。

書いてみたのは、下に貼り付けたような、十数行ばかりのPython/Jupyterコードです。OpenCV でテクスチャ検出をして、その(円形マーカーの)大きさや形状の歪みを使って、模様部分の体の表面形状情報を推定する…というわけです。Pythonコードを実行した結果は、たとえば下の4 図のようになります。向かって左から、元画像・高さ(凹凸)画像・向き(180度の反対側を区別できない)画像・法線画像です。この処理例は、水玉模様の水着画像で処理を行ったものですが、新型ZOZOスーツ画像でも同様のことが行えます。

この画像を見れば、水着の模様を介して胸やお腹の3次元形状が見えてくることがわかります。全身に模様が付けられたZOZOスーツを着用した自撮り写真がアップされたら…色んな体形状を可視化できそうです。

import numpy as np

import cv2

from matplotlib import pyplot as plt

from math import sin, cos

img = cv2.imread('zozo_polka202.jpg',2)

cimg = cv2.cvtColor(

cv2.imread('zozo_polka202.jpg'),

cv2.COLOR_RGB2BGR)

img = cv2.adaptiveThreshold(img, 128,

cv2.ADAPTIVE_THRESH_MEAN_C,

cv2.THRESH_BINARY_INV, 15, 5)

img, contours, hierarchy = cv2.findContours(

img, cv2.RETR_LIST, cv2.CHAIN_APPROX_NONE)

if len(contours) > 0:

for i, contour in enumerate(contours):

if (contour.shape)[0]>4:

ellipse = cv2.fitEllipse(contour)

aMax = max(ellipse[1][0],ellipse[1][1])

aDiff = abs(ellipse[1][0]-ellipse[1][1])

if aMax < 20 and aMax > 11 and aDiff < 12:

xc = sin(ellipse[2]*np.pi/180)*255

yc = cos(ellipse[2]*np.pi/180)*255

cx=int(ellipse[0][0])

cy=int(ellipse[0][1])

cv2.ellipse(cimg,ellipse,

(xc,yc,255-xc),-1)

#cv2.circle(cimg, (cx, cy), int((aMax-11)*2.0),

(xc,yc,255-xc), -1, -1)

#cv2.ellipse(cimg,ellipse,(int((aMax-11)*50.0),

int((aMax-11)*50.0),int((aMax-11)*50.0)),-1)

#cv2.ellipse(cimg,ellipse,(int((aMax-11)*50.0),

yc+xc,int((aMax-11)*50.0)),-1)

plt.imshow(np.array(cimg))