2018-07-03[n年前へ]

■深層学習で「体が入れ替わってる!?」妄想カメラを作る!

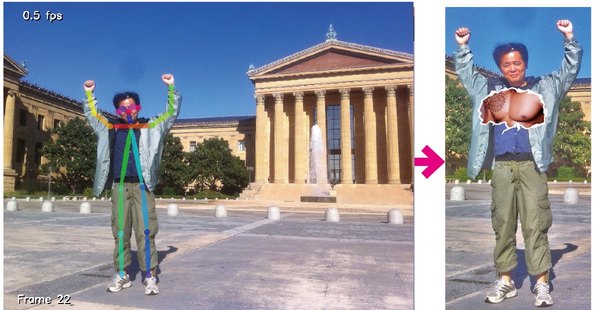

発売中の「Software Design 2018年7月号」に、4p記事を書いています。題して『深層学習で「体が入れ替わってる!?」妄想カメラを作る!』です。深層学習とか機械学習といった仕事に役立つトピックというわけではなく、いわゆるひとつの「妄想カメラアプリの作り方」です。つまり、アレ。写真機=カメラというものは、現実の姿を写すのではなくて、「撮影者が写したい=あると良いな…と願った姿を写すべきだ!」という気持ちで作ったあのソフト作成方法です。つまり、"as it it is"ではなく"as it should be"な姿を描き出す妄想的な光画装置です。

発売中の「Software Design 2018年7月号」に、4p記事を書いています。題して『深層学習で「体が入れ替わってる!?」妄想カメラを作る!』です。深層学習とか機械学習といった仕事に役立つトピックというわけではなく、いわゆるひとつの「妄想カメラアプリの作り方」です。つまり、アレ。写真機=カメラというものは、現実の姿を写すのではなくて、「撮影者が写したい=あると良いな…と願った姿を写すべきだ!」という気持ちで作ったあのソフト作成方法です。つまり、"as it it is"ではなく"as it should be"な姿を描き出す妄想的な光画装置です。

Vimファンのあなたに…じゃやなかった、プログラミングを始めようとしている中2男子なら、この記事を読んでみるのも面白いと思います。(今、気付いたけれど、そんな年齢層の読者がいない感じの雑誌だったかも)

■Powered

by yagm.net