2010-12-10[n年前へ]

■「iPhone4を3D化するキット」買いました。

「iPhone4を3D化するキット」を見かけ、とても楽しそうだったので思わずってしまいました。「iPhone用3Dビュアーレンズ」と題したそのセットは、(iPhoneのサイズを十分カバーする大きさの)レンチキュラーレンズと(そのレンチキュラーレンズを使って)立体表示を行うための画像変換を行うソフトウェア一式の紹介文章が付属している、というキットです。販売しているブースを眺めたとき、何だか心から楽しそうな雰囲気が感じられて、思わず買ってしまったのです。

「iPhone4を3D化するキット」を見かけ、とても楽しそうだったので思わずってしまいました。「iPhone用3Dビュアーレンズ」と題したそのセットは、(iPhoneのサイズを十分カバーする大きさの)レンチキュラーレンズと(そのレンチキュラーレンズを使って)立体表示を行うための画像変換を行うソフトウェア一式の紹介文章が付属している、というキットです。販売しているブースを眺めたとき、何だか心から楽しそうな雰囲気が感じられて、思わず買ってしまったのです。

表示するデバイスの液晶解像度は、変換ソフトウェアで各種対応できるようですし、付属のレンチキュラーレンズの大きさもiPhoneよりはかなり大きなサイズなので、iPhone4に限らず色々なデバイスで使うことができそうなキットです。

その後、「PCで立体視してみるぶろぐ」を読みながら、そこで色々教えてくれた方が「自作裸眼立体視ディスプレイを作った人」だったことに気づかされました。その場で気づけば、もっと色々なことを教えてもらうことができたのに・・・と後悔することしきり、です。

その後、「PCで立体視してみるぶろぐ」を読みながら、そこで色々教えてくれた方が「自作裸眼立体視ディスプレイを作った人」だったことに気づかされました。その場で気づけば、もっと色々なことを教えてもらうことができたのに・・・と後悔することしきり、です。

ところで、動画ファイルに対して単純な画像処理をかけて表示する程度のことであれば、ハイビジョンサイズでも、iPhone3GS以降ならリアルタイムに行うことができます。Youtubeなどの3D映像ソースをダウンロードして、(レンチキュラーレンズ表示対応の)「3D映像プレイヤー」を作ってみるのも面白いかもしれません。

2016-04-16[n年前へ]

■両瞳に映り込んだ世界から3D世界を復元してみよう!?

政党ポスター中の三原じゅん子を見ると、その瞳に照明もしくは明るいレフ板が写り込んでいるようすがわかります。さすがに女優さんらしく、下部には大きな女優ライト風照明(もしくはレフ板)が使われているな…と思いながら、ふと「両目の表面に映り込む世界は、目の幅で配置された超魚眼カメラで撮影した世界だから、そのステレオカメラから(三原じゅん子さんが見た)立体世界を復元できないだろうか?」と考えました。

政党ポスター中の三原じゅん子を見ると、その瞳に照明もしくは明るいレフ板が写り込んでいるようすがわかります。さすがに女優さんらしく、下部には大きな女優ライト風照明(もしくはレフ板)が使われているな…と思いながら、ふと「両目の表面に映り込む世界は、目の幅で配置された超魚眼カメラで撮影した世界だから、そのステレオカメラから(三原じゅん子さんが見た)立体世界を復元できないだろうか?」と考えました。

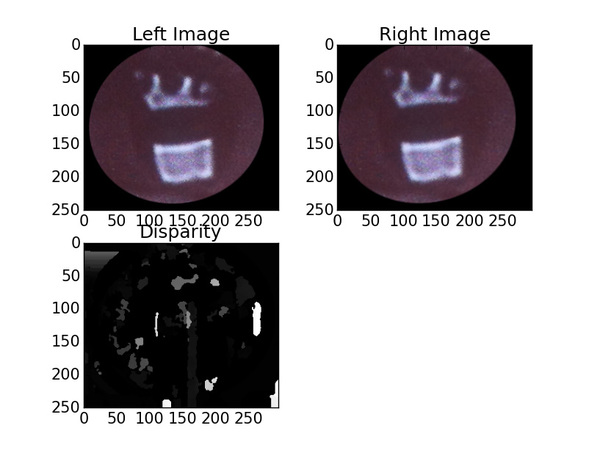

そこで、三原じゅん子さんの左右両目の瞳表面に反射して見える魚眼世界を、適当に歪み補正した上で、両眼視差から距離マップを復元しよう!としてみたのが下図に示す結果です。…残念ながら、今回は「それっぽい」世界を得ることができませんでした。

2016-09-06[n年前へ]

■Dual Pixe Raw画像から距離(深度)マップを作成してみる!?

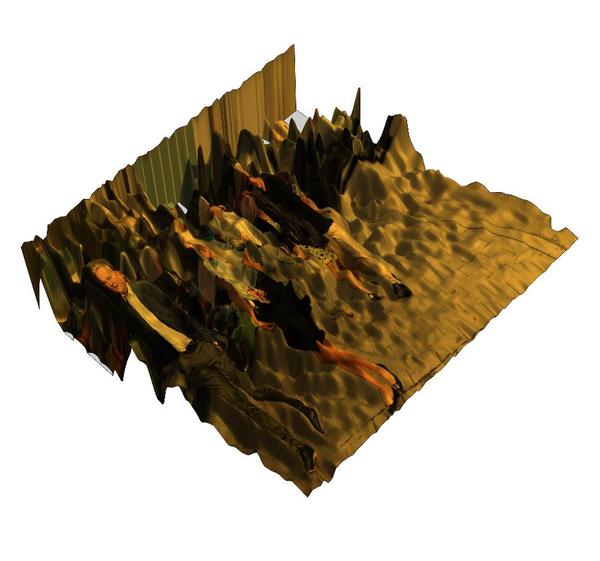

撮像素子の各画像素子を2分割して、その情報差を使って任意の場所でオートフォーカスしたりするための生画像データ(Dual Pixel Raw画像)を展開するソフトが公開されていました。 そのツールを使って(微小距離離れた)2視点から同時撮影された画像の情報を元に、言い換えれば2視点(AとB)に記録された光情報をAとA+Bという2形態で記録された画像データとして展開し、写された景色までの距離を各画素毎に算出した深度マップを計算してみました。といっても、やったことは単純で、2視点で撮影した画像パターンの相関をもとに三角測量的に距離を出してみたのが、下に貼り付けた画像です。

そしてまた、推定した距離画像に、RGB色画像をテクスチャマッピングして3次元的に眺めてみた例が右の画像です。近景を歩く数人と、その後ろに広がる遠景が形作る箱庭のような風景をこんな風に3次元グラフとして眺めてみるのも面白いような気がします。

そしてまた、推定した距離画像に、RGB色画像をテクスチャマッピングして3次元的に眺めてみた例が右の画像です。近景を歩く数人と、その後ろに広がる遠景が形作る箱庭のような風景をこんな風に3次元グラフとして眺めてみるのも面白いような気がします。

ちなみに、Dual Pixe Raw画像から得られた2視点画像を、「視差アニメーションGIF」的に眺めてみたアニメーションは下動画のようになります。立体感をどれだけ感じるかは微妙ですが、割と面白い結果が得られたので、ここにメモしておくことにします。