1999-06-26[n年前へ]

■リモートカメラから世界をノゾこう!

Macintosh用カメラ制御プログラムを作る

今日もニュースを探しに

MAQ?MAK?MAC! ( http://www.maqmakmac.com/)

を見に行くと、おやおや何やら見たことのあるキーワードがある。これが「デジャブ」という奴かと一瞬思ったが、そうではないようだ。本WEBについての記載がある。ビックリだ。いや、ホント。

自分の興味の趣くままにやっているサイトではあるが、好きなサイトで「面白い」といってもらうと、とても嬉しい。また、そこから辿り

WebCatchを見る。「ノーラ」氏の文章には頭が下がる思いである。

MAQ?MAK?MAC!には「もっとMacintoshに関連した話題が多ければ良いのになぁ?。 」とも書いてある。そう、私もMacintoshの話題が少ないとは思っていたのだ。Macintoshが多い私の職場の人々からも(次回の話への伏線)言われ続けてきたことなのである。ならば、MAQ?MAK?MAC!( http://www.maqmakmac.com/ )登場記念にMacintoshを使った話をやってみたい。

というわけで、今回は急遽Macintoshを使った実験の話である。物語は、こんなジャンクを手に入れたところから始まる。ごくたまに、秋葉原でも見かける。もし見かけて、かつ、安かったら、迷わず「買い」だ。LEGOのMindstormsなんかと組み合わせたら、かなりかっこいいはずだ。

|

これが、「Canon製ビジュアルコミュニケーションカメラ」である。シリアル通信でカメラの向きやズームピントを変えることができるものである。上下左右に首を振ることができるし、ズームやマクロ撮影も可能だ。発売当初は20万円位もしていたものだ。この後継機種も出ている。

これを使って、何か面白いことをしてみようと思った。いや、はっきり言ってしまえば、ネットワーク上のMacintoshにこのカメラをつなげて、それを他のコンピュータから制御しようにしたい。今でこそ、そういったWEBサイトも多々あるが、今回の話の実験を行った時(確か2,3年前)にはまだ少なかったのだ。

このカメラはジャンクとして手に入れたので、ソフトも何も付いていない。しかし、シリアル通信のコマンドは何とか判明したので、制御プログラムを作ってみた。といっても、単なるシリアルポートへコマンドを送りつけるプログラムである。

プログラムはここに置いておく。名前もずばり、「のぞき見君」である。もちろん、Macintosh版なのでWindowsでは使えない。

のぞき見君 0.1anozokimi01a.sit ( sit形式 332kB )

正式にこのカメラを持っているユーザーにも今回のような用途(イヤな用途である)であれば、このソフトはきっと役に立つと思う。

今回(といっても作成したのはずいぶん昔だ)作成したプログラム「のぞき見君」の起動画面が下である。

|

下がメニュー画面である。画面を見れば判ると思うが、全てのメニューをコマンドキーを用いてキーボードのみでコントロールするようにしてある(これが素早く使うためのミソだ)。

|

このソフトをインストールして、Macintoshとカメラをシリアルポートでつないで、また、ビデオ出力もMacのビデオ入力につなげばとりあえず、接続完了だ。これで、Macintoshから自由自在に制御できるビデオカメラの完成だ。

さて、次はネットワーク経由で制御するための作戦だが、何ら苦労(私の)は必要ない。例えば、innfo-macに登録されているremote-mouse-keysというようなソフトを使えば、ネットワークにながっているMacintoshのキーボードやマウスを制御することが簡単にできる。

ftp.flashnet.it/mirror/8/sumex-aim.stanford.edu/comm/remote-mouse-and-keys-10.hqx

ビデオ画面の転送はもちろん、Cu-SeeMeでも使えば良い。最近はその手のソフトも多いだろう。それでは、今回のプログラム群を使った構成図を以下に示す。Macintoshはネットワークの自由度が高いので色々な使い道がある。

|

remote-mouse-keysとCu-SeeMeの組み合わせが軽くてお勧めなのだが、今なら

vnc (http://www.uk.research.att.com/vnc/index.html )

を使うといったやり方もアリだろう。これなら、プラットフォームをあまり選ばないので、WindowsやUnix系OSからでも制御できるし、一つのソフトで制御もビデオ画面転送も済んでしまう。ただし動作がまだ重いとは思う。

それでは、今回のソフトを使った顧客例を紹介しよう。

それは私の職場の「ち*の」氏の使用例である。彼は結婚間近であった。いずれ妻と住む新居にPowerMacintosh6100がこのカメラとともに設置してあった。彼は家の戸締りが気になって、職場から家にPPP経由でRemote-Accessを試みた。彼のPowerMacintosh6100は電話がかかってくるとともに起動音を発し、起動した。そして、彼は職場からの制御により、家のPowerMacintosh6100につながったカメラは首を起こし右へ左へと方向を変え、戸締りのチェックを始めた。彼の目的は達成された。家の戸締りは完璧であった。

ただ一つの問題は、彼は知らなかったが、結婚間近の恋人が掃除をするために新居を尋ねていたことである。彼女の目の前で、電話の音とともに勝手にMacの電源が入り、「ジャーン」という音を発し、そして、そこにあるカメラが「ウィィィーン、ウィィィーン」と右へ左へ動き始めたのである。「ひどい恐怖を感じました」、と彼女は後に語ることになる。

その後、彼の結婚がはたして実現したのか、それとも実現しなかったのかはここでは明らかにしない。

1999-07-08[n年前へ]

■走査線の狭間

1/60秒の世界を目指せ

あぁ、今回は(今回も)めちゃくちゃマニアックな話である。トップページには「身近な疑問を調べる」、と書いてあるが、他の人にはぜんぜん身近ではないだろう。最近、妙に忙しいので、身近な疑問がおろそかにされているのだ。身近な疑問の解決は結構難しいのである。そのため小難しい話が続くのだ。困ったことだ。

さて、今回やったことを結論から言えば(*)、AVIファイルをフィールド毎に分解してBitmapファイルに落とすプログラムを作ったのだ。「このソフトはとても便利だ」と言ってくれる人がいたならば、感謝感激雨あられだ。とりあえず、私には欠かすのことのできないソフトである。なぜ、このソフトがそんなに便利なのかを、これから手短に(**)語りたい。

* 「結論から言えば」、とか、「要するに」という人は必ず結論を言わなかったり、全く要約されていない話をするのはなぜだろうか?

** 同じく、「手短に」ときたら、必ず話は長くなる。

一般的なTVで使われている信号はNTSCと呼ばれる。1秒あたり約30フレームからなり、1フレームは2フィールドにわけられる。というと、複雑に聞こえるが実はとても単純だ(***)。単に1フレームが奇数フィールドと偶数フィールドに分かれているだけである。フィールドというとわかりにくいので走査線と考えればわかりやすい、と思う。

*** 当然のごとく、単純ではない。

NTSCの信号を時系列で追うとこのような画像の集合になっている。例えば、こういう具合だ。

1フレーム目の奇数フィールド(走査線)

1フレーム目の偶数フィールド(走査線)

2フレーム目の奇数フィールド(走査線)

2フレーム目の偶数フィールド(走査線)

.

.

.

29フレーム目の奇数フィールド(走査線)

29フレーム目の偶数フィールド(走査線)

30フレーム目の奇数フィールド(走査線)

30フレーム目の偶数フィールド(走査線)

30フレームで約1秒であるから、1枚の画像(フレーム)は約1/30秒である。だから、普通のビデオカメラで撮影した画像は1/30分の1秒毎の画像を示しているのである。しかし、もっと高速度撮影したいと思うときがある。ウン百万出せば、1万分の1秒の撮影でも可能な高速度カメラが買えるが、個人ではとても買えない。また、そもそもやりたい用途向けの高速度撮影用のカメラが存在しない場合というのもままあるのだ。そういった場合には、時間軸に対しては1/30秒までの撮影にしか使うことはできない、と思えるだろう。

しかし、NTSCの信号もフィールド毎に分解すれば、1/30秒の半分、すなわち1/60秒毎の画像を示しているのである。たかだか2倍ではあるが、されど2倍である。1/30秒では見えていなくても、1/60秒では見える世界というのもあるのだ。

画像例を用いて説明しよう。左の1/30秒間の画像を奇数フィールドと偶数フィールドに分解したのが右の画像(a),(b)だ。(a),(b)を比べると、黒い矩形が左から右に移動しているのがわかるだろう。今回のソフトウェアはそういった計測には非常に便利なのだ。このソフトウェアを使えば、普通のビデオカメラの性能を2倍にすることができるのだ。スポーツをやる方などは自分のフォームをチェックするのに使うといいだろう(画像解析までしてフォームチェックはしないか、普通...)。これで、フォームチェックはプロ級だ。

| 1/30のままの例 | 1/60のフィールドに分解した例 |

|  |

|

1/30と1/60がたかだか2倍でも結構違うという良い例は、1/30秒のシャッタースピードではブレた写真になってしまう人でも、1/60秒なら大丈夫、とか、ゲームを作る際に1/60秒以内に人間からの入力に対して反応を返してやれば、プレーヤーはスムーズに感じるが、1/30秒ではダメだ、とかいう話がある。

というわけで(****)、AVIで記録された動画ファイルを1/60毎の画像に分解するプログラムが今回作成したものである。

|

奇数フィールドと偶数フィールドを分けることにより2枚の画像に分解し、それぞれの画像内で失われたフィールドを単純補間により復元することができる。奇数フィールドが先頭か、あるいは、偶数フィールドが先頭かは選ぶことができるし(奇数フィールドと偶数フィールドのどちらが先か選べるということでもわかるように、どちらが先であるか必ずしも決まっているわけではないらしい。そこらへんは、各映像機器によって変えなければならない。)、インターレースでなくノンインターレースの場合、つまり、単にAVIファイルの各画像を静止画におとすことだけもできる。

**** 「というわけで」は話を強引に次へつなげるときに使う。

このプログラムを使ったあとはScion ImagePCを使うのがお勧めだ。Macintoshの世界で一般的なNH-imageのWindows版である。今回のプログラムで作成した静止画群をスタック化して使うのがいいと思う。そうそう、Scion ImagePCに読む込むときには静止画を8bit(gray)画像へと前処理しておくことがお勧めだ。

1999-10-07[n年前へ]

■CCDカメラをバラせ!

モアレは自然のClearText

あまり、「できるかな?」では工作の話題が出ていない。いや、もしかしたら全然出ていないかもしれない。そこで、手元に8mmビデオのジャンクがあったので、こいつをバラしてみることにした。そして、これまで「できるかな?」に登場しているような話に関連していることがないか調べてみるのだ。いや、本当は嘘で計画済みの伏線張りまくりの話である。もしかしたら、勘のいい方はもう話の風向きはもうおわかりかもしれない。

さて、今回分解するカメラはかなり前(といっても数年前)のモデルである。まずは、分解してみよう。

|  |  |

|  |  |

|  |

5.の写真でわかるように、CCD前部にはフィルターが着けてある。(当初はこれを赤外線フィルターだと考えていた。なので、このフィルターを外してやると、画質はとんでもないことになる。しかし、その上で赤外線投光器を装着すれば面白いカメラになりそうである。が、用途を間違えるととんでもないことになるので、今回はやらない。が、いつかやってみようとは思っている。もちろん、私は品行方正がモットーであるので、悪用はするわけがない。もちろんである。)と、書いたがその後、「これは赤外線とは逆のエイリアシング防止用のハイカットフィルタだろう」というご指摘を頂いた。フィルターが青色だったので、単純に赤外線カット用途かと思い込んでいたが、どうやら違うらしい。指摘の文章をそのまま、使わせていただくと「CCDは空間サンプリング素子であり、サンプリング周期(ピクセルのピッチ)よりも短い波長の光が入ると、エイリアシング(折り返しノイズ)を生じて擬似カラー、干渉縞を生じてしまいます。これを避けるためのハイカットフィルタです。」とある。その後、知人から頂いた資料(勉強しなおせ、ということだろう)を読むと、水晶板をだぶらせて2重像にすることにより、細かい解像ができないようにしているローパスフィルターであるようだ。空間周波数のローパスである。今回のCCDでは3層構造になっており、中央の層にのみ色がついている。反省がてら、次回にもう少し調べてみようと思う。

ところで、7.などの拡大画像で周辺部が丸くケラれているのがわかると思う。これは、

と同じく実体顕微鏡の接眼部からデジカメで撮影を行っているからである。デジカメはこういう時に何より重宝する。さて、デジカメと言えば、こちらも同じくCCDを用いているわけである。さて、8.の拡大画像を見ると、このカメラのCCDのカラーフィルターは補色方式(CMYG=シアン、イエロー、マゼンダ、グリーン)であることがわかる。原色タイプでないところを見ると、どうやら感度重視の製品であるようだ。また、この拡大画像などを眺めると、

で調べた液晶のフィルターと同じような構造であることがわかる。よくストライプ模様の服を着ている人をCCDビデオカメラで撮影すると、モアレが発生することがあるが、それはこういったフィルターの色の並びに起因しているわけである。フィルターの周期とストライプの模様が干渉してモアレが生じてしまうのである。 最近のものではソフト的にかなりの処理をしてモアレが出にくいようにしているし、CCDも高解像度化が進んでいるので、なおさら出にくい。私が使用している富士写真フィルムのFinePix700でそのようなモアレを出そうと思ってみたが、なかなか出なかった。むしろ、ピントを正確に合わせることができなかった。それでも、何とか白黒の縦線模様を撮影して、モアレを出してみたのが下の写真である。左がオリジナルで、右がそれに強調処理をかけたものである。

|  |

モアレが発生しているのがわかると思う。さてさて、こういう白黒ストライプをよく眺めてみれば、

で登場したこの画像を思い出すはずだ。 |  |

そう両者ともまったく同じ斜線である。そもそも、前回作成したパターンは今回への伏線であったのである。白黒の縞模様を撮影しているのであるから、普通は白黒模様しか撮影されない。しかし、モアレが発生している場合というのは、CMYGからなる1画素の中でのさらに細かな位置情報が判るのである。先ほどのCCDの色フィルターの拡大写真のような配置になっていることを知っているのであるから、その配置も考慮の上処理してやれば良いのである。もちろん、白黒の2値からなる画像を撮影しているという前提条件は必要である。その前提条件さえつけてやれば、モアレが生じていることを逆に利用して、高解像処理ができるはずだ。

例えば、

| Green | Magenda |

| Yellow | Cyan |

という画素のGreenだけ出力が大きかったとすると、グレイ画像であるとの前提さえ入れてしまえば、1画素のさらに1/4の領域まで光が当たっている位置を推定できるということになる。もちろん、実際のカメラでも4色の間で演算をしてやり、ある程度の推定はしているだろう。しかし、前提条件を入れてやれば、より高解像度が出せるだろう。

ClearTextの場合は白黒2値の文字パターン、あるいはハーフトーンという前提条件をつけて液晶に出力を行った。今回は、白黒2値の文字パターン、あるいはハーフトーンという前提条件をつけて、CCDからの出力を解釈してやれば良いわけである。CCDカメラにおいては自然が自動的にカラーシフト処理をしてくれるのである。そのカラーシフト処理からオリジナルの姿を再計算してやれば良いわけである。もっとも、これらのことは光学系がきちんとしている場合の話である。

今回考えたような、そういった処理はもうやられていると思う。FinePix700でも撮影モードに

- カラー

- 白黒

|  |

うーん、白黒のほうがキレイなような気もするが、よく判らない。念の為、強調処理をかけてみる。もしかしたら、違いがわかるかもしれない。

|  |

うーん、これではますます違いがよくわからない。これは、次回(すぐにとは限らないが)に要再実験だ。ただ使っている感覚では、まずピントがきちんと合わないような気がする。うーん、難しそうだ。それに、今回の実験はローパスのフィルター部分をなくしたものでなければならなかったようにも思う。ならば、FinePix700を使うのはマズイ(直すのメンドクサイから)。どうしたものか。

2000-02-13[n年前へ]

■競馬の写真判定とパノラマ写真

パノラマ写真と画像処理 Part.2

前回 、

の時にi_matさんから頂いたメールを紹介した。i_matさんは- I*MAT The HomePage (http://www.nsknet.or.jp/~i_mat/ )

- atoz@gol.com (http://www2.gol.com/users/atoz/index.html )

さて、前回

これらのソフトのStack-Slice機能を用いれば「複数画像(動画)からの走査線抽出」ができる。その使用例と、その面白い座標軸変換について考えてみたい。と書いた。今回もまた「数日後には登場」と言った割には時間が経っているような気もする。しかし、ここのところ文字通り忙殺されていたのである。と、言い訳をしながら今回この作業をやってみることにした。しかし、このページは少々重くなってきた。まして、走査線の抽出の話は使用画像が多くならざるをえない。そこで、次回、詳しく使用例を紹介することにする。

よく、次回登場と言ったまま数ヶ月経つことがあるが、今回は大丈夫である。少なくとも数日後には登場することと思う(多分)。

まずは、

- 「複数画像(動画)からの走査線抽出」

- 「座標軸変換」

以下に示す連続の画像は競馬のゴール地点に競走馬が到着した瞬間である。「馬に見えない」という人がいたら、それは目がおかしい。誰がなんと言おうとこれは馬である。馬と鹿の区別がつかない人は馬鹿と呼ばれるが、これはとにかく馬なのである。

視野の中に馬がもっと入ってくる。

視野の中に馬がものすごく入ってる。 |

さて、このビデオカメラで撮影された画像は例えば以下のようなものである。

|

撮影された各時間の画像から、この画像の赤で囲んだところを抽出し、並べたらどのようになるだろうか?

それはこのようになるだろう。よくある競馬の着順判定写真である。

|

一見、これまで眺めてきたビデオカメラで撮影された画像と同じように見えるが、全く違う。ビデオカメラの撮影画像の動画中における、複数画像間の「位置」は全く変化していない。変化しているのは「時間」だけである。

だから、このような赤い長方形の画像を並べた方向というものは「時間軸」を意味しているのである。それを、下の画像に示してみる。

|

この画像は縦方向は「空間軸」であるが、横方向は「時間軸」なのである。ビデオカメラの画像が縦横共に「空間軸」を示しているのに対し、その一軸を「空間軸」から「時間軸」に変換したものなのである

この競馬の着順判定写真の場合、カメラは空間に固定され「時間軸に変化するもの」を撮影していた。だから、このように各画像から一部を抽出して並べると、それは「時間軸」に対する変化を示すものを得ることができる。

また、例えば実験条件を変えたときの計測画像に対して「各画像から一部を抽出して並べる」ということをするならば、それは「空間軸」x「実験条件」というものを表す画像を得ることができる。

それでは、時間的には変化しないものを、ビデオカメラで撮影する方向を変化させながら撮影したらどうなるだろうか?例えば、ビデオカメラを下のようにして360度回転させながら撮影をしてみるのである。

|

この場合撮影画像の各画像は撮影方向角度が異なるわけである。従って、先ほどのように一部分を抽出して並べると、一方向は「空間軸」であり、もう片方の軸は「撮影方向角度」になる。結局当たり前ではあるが、ある位置から眺めた周りの景色が得られるわけだ。

これが、前回i_matさんの要望していた

- 8ミリビデオを横倒しにして、 モーター回転するヘッドでぐるりと360度撮影し、

- その撮影した動画ファイルの、各フレームから走査線にして数本分を抽出し(インターレースで256本のうちセンター128本目の前後数本の走査線分)、

- それを貯めて1枚のjpgファイルにする、

- そのJPEG画像をMakeQTVRPanoramaの入力にして、パノラマムービーを作る、

それでは、その作業を実際にしてみようと思う。i_matさんから送って頂いた動画ファイル

を使い- 動画から静止画に変換し(走査線の狭間-1/60秒の世界を目指せ- (1999.07.08) 参照)、

- Image PC(NIH-imageをWindowsに移植したもの)で、走査線の一部を抽出し並べた静止画を作成する

もういきなり結果を出してしまおう。これが、「動画ファイルから走査線を抽出し、パノラマ写真にしたもの」である。

|

おや?何が何だかわからない画像になってしまっている。変なモザイクがかかったみたいな画像になっているし、グレイ画像である。参考までに、先ほどの動画から手作業でパノラマ画像を作成したものを以下に示す。上の画像と比較してみると画像の示すものの対応がわかるだろう。

|

さて、今回の実験結果が

- 変なモザイクがかかったみたいな画像になっている

- グレイ画像である

まず、

- 「グレイ画像」になっている理由

そして、「変なモザイクがかかったみたいな画像になっている」のは(動画中の)各画像から走査線をそれぞれ一本しか抽出しなかったからである。だから、横方向(カメラの撮影方向角度)のデータが足りないのである。そのため、モザイク画像のようになってしまったのである。

本来、抽出する走査線の数は、カメラの回転速度に応じて増やしてやらなければならないわけであるが、それが上手く合っていなかったのである。また、今回の画像を見て頂くと判ると思うが、動画ファイル自体も、実は一秒辺りのフレーム数が間引かれたものとなっている。それにより、抽出する走査線の数が一本ではますます足りなくなってしまっていたのである。

というわけで、今回は「失敗した」と言わざるをえない。何か、前回は「簡単である」などと言い切ったような気もするが、それはきっと気のせいであろう。

やはり、これは適当にあるもので間に合わせ仕事をしようとしたせいかもしれない。いつの日か「mov2panorama.exe」を作成し、必ずや必ずや再挑戦をするつもりである(Macでやるのは少しあきらめモード)。

2000-03-26[n年前へ]

■透け透け水着の物理学 入門編

透過率の波長依存を探れ

少し前のことだった。舞台は妙高高原の露天風呂である。同じ職場の人とある話をしていた。話題は仕事に関する話で、主な話題は色々な物質の光の透過率や吸収の話だった。ずいぶん長いこと、そういった話題をしていた。

しかし、ふと気づくとなにかがおかしい。会話中に出てくる言葉が変なのである。さっきまで話していた「吸収波長」とか、「感度」とかいう言葉は依然として出てくるのだが、それに加えて変な言葉がどうも出ている。「透け透け水着」とか「丸見え」とか「ナイトショット」といった類の言葉である。これは一体どうしたことだ?これは非常にマズイ。

私たちがいるのは露天風呂である。私たちの数m横の壁の向こうは女性用の露天風呂だ。そこで、私たちは「透け透け水着」と「丸見え撮影」の話題をしているのである。非常に危険なシチュエーションである。逆に、隣の女性用露天風呂に入浴している人がいたならば、とてもイヤなシチュエーションである。隣が「変態さんいらっしゃい」状態だと思ってしまうだろう。

もちろん、心ある人が聞けば、私達が極めて誠実に「透け透け水着」と「丸見え撮影」の「科学」について論じているのはわかるはずだ。ましてや、私という人間を知っていたならば、なおさらである。

しかし、周りはもちろん私達の知り合いではないわけで、誤解されても何らおかしくない。いや、誤解されないのが不自然な位である。

もちろん、私は見えないものを可視化するのが大好きであるし、「32cmの攻防戦」について論じたこともあるが、誤解はしないで欲しい、とあの時周りにいた人達にひとこと言っておきたい。

さて、その時に話していたのは、ビデオカメラで水着が透けて見える話についてであった。あの有名なSONYの「ナイトショット」機能付きのHandyCamのことである。そのカメラでどうして水着が透けて見えるのかについて論じていたのである。その見える理由を聞かれた私は「透け透け水着は赤外線の透過率が高いから、と言われていますね。」と答えた。

例えば、「水着、透ける、ビデオ」で検索すれば、そういう解説が数多くある。それに、私は赤外線フィルムを使って風景撮影をするのが好きだったので、いくらか知識もある。しかし、それはあくまでも知識である。実際に水着の赤外線の透過率を調べたことがあるわけでもないし、可視光との差を比較したことがあるわけでもない。それはあくまで知識だけ、である。実証の伴わない知識というのは今ひとつ好きではない(いや、盗撮を実証するわけじゃないけど)。

そこで、今回は「水着が透ける理由」を実証してみたい、と思うのである。 透ける理由として、よく言われている

- 水着の色や生地によって波長毎の光の透過率が異なる

- 水着によっては、赤外光は屈折・散乱しにくく、透過率も可視光に比べて高いものがある

- 簡単に言えば、その水着は赤外光は透過しやすい、ということである

- ということは、赤外光で撮影をする限りにおいて、その水着は半透明であるようなものである

- また、可視光の影響を防ぐため、可視光をカットするフィルターを用いて、赤外光のみで撮影をする

- すると、なんと水着が透けて見える

さて、先ほどの「透け透け水着は赤外線の透過率が高いから、と言われていますね。」という言葉を実証するためには、色々な生地の透過率を波長毎に調べなければならない。そのためには、光を波長毎に分解する分光器が必要である。そこで、私は

で分光器を作ったわけである。 前回は、分光器の出力をデジカメで撮影した。しかし、これでは赤外光の計測もしづらい。そこで、秋月で可視・赤外対応のCCDボードを買ってきた。これを前回作成したHIRAX一型分光器に取り付けて、計測を行った。名付けて、「HIRAX一型分光器CCD+」である。

|

まずは、その分校計測出力例を示してみたい。下の写真は「CCDカメラで計測したスペクトルに、可視光の色対応を示すカラーバーを上に示したもの」である。これは前回と同じく、太陽光のスペクトルだ。水平軸が波長を示している。左が波長が短い領域であり、右が波長が長い領域である。可視光領域は左の1/3くらいの領域である。

鮮鋭化処理をかけたもの  |

今回は、縦線状に見えるフラウンホーファー線が明らかに数多く見えるのがわかると思う。HIRAX一型分光器自体もスリット幅の改良などで性能がアップしてるのである。

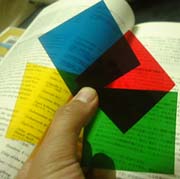

それでは、まずはいくつかの材料の波長毎の透過率を計測してみたい。まず、使う材料は下に示すような色フィルターである。もちろん、こんな透け透けの材料で作った水着を着ている人なんているわけはない。これは、あくまで例である。

|

それでは、次に「HIRAX一型分光器CCD+」で計測した波長毎の透過性を示してみよう。まずは、赤色フィルタである。赤色フィルタを使用している部分は、使用していない部分に比べて、赤色(そして赤外領域)以外の波長がカットされているのがわかる。

|

例えば、赤色が見えづらい人であれば、このフィルターは透過性が非常に低く、「透け透け度」が低いフィルターである、ということになる。また、赤外光は透過しているが、すごく長波長側では透過率がかなり低いことがわかる。

また、次が黄色であり、赤色フィルタよりも短波長側まで透過性が高くなっていることがわかる。そして、赤外光の透過性は赤色フィルタよりも高い。

|

次に示す緑色のフィルタの場合は、緑の辺りの波長と赤外領域辺りの透過性が高いことがわかる。よく、ビデオカメラで赤外リモコンなどの赤外光を撮影すると、緑色に写ることがあるが、あれはこういった緑色のフィルタを使用しているのだろうか?

|

次が青色フィルタである。赤外光の透過性は結構低い、こともわかる。

CCDカメラで計測したスペクトルに、色対応を示すカラーバーを上に示したもの |

色々、面白いこともある。例えば、赤色フィルタの透過特性と緑色フィルタの透過特性を比べると、重なり合う(透過性が高い)領域(波長)がほとんどないことがわかる。

|

|

だから、赤色フィルタと緑色フィルタを重ねると、全然透けないわけだ。透過可能な波長領域がないワケである。こういうのを見ると、暗記用の赤色ペンと緑色下敷きの組み合わせを思い出してしまう。

|

さて、こういう風に材料毎の透過性を計測できるようになったわけである。さらに、赤外線フィルタの透過性を見てみたい。赤外線の波長領域をまずは実感してみたい、ということである。赤外フィルタは赤外リモコンの発光部のカバーを使用してみた。下に示すのが、「赤外フィルタ= 赤外リモコンの発光部のカバー」であり、

|

次が、赤外フィルタの透過性を示したものである。可視光はほとんど通さず、波長の長い赤外光のみ通過させているのがわかる。

|

さて、あまりにも画像が増えてページが重くなってきた。今回は分光計測を行い、赤外線フィルターの分光感度を計測したところまでで終わりにしたい。次回は、色々な生地の透過分光計測を行う予定である。「色々な生地が可視光では透過率が低くても、赤外光では透けて見えることがあるのか」調べてみたい、と思う。